IDチームの前田です。最近KZ Castor(Improved Bass Version)という中華イヤホンを入手しました。低価格なのに愛用しているSE215 SPEやIE100 Proと遜色ない高品質な音質で、低音重視の方にオススメです。

今回はエンジニア職でない方達に利用してもらえる自然言語による対話を行いプログラミング作業を行うことが出来るOpen Interpreter専用環境の構築について調査しました。

ちなみにデスクトップアプリの開発が進んでいるようなので、近々専用環境を用意する必要はなくなるかもしれません!と言う情報をはじめに書いておきます。

三行まとめ

- 情シス活用観点から業務効率化のため、社内の誰もが手軽にAIプログラミングを利用できるOpen Interpreter専門環境の構築について調査

- 2024/02/19現在、構築の容易さ、継続的なメンテナンスコストを考慮し、GitHub Codespacesが最適である

- Open Interpreterは大変便利ですがOpenAI API / Azure OpenAI APIの費用が非常にかかるため、コスト監視や利用者への教育は必ず行いましょう

Open Interpreterとは

Open Interpreterは、AIを使って自然言語での対話を行いプログラミング作業を行うことが出来るツールです。

Open Interpreterを利用することで、プログラミングの知識がない方でも、作業の自動化、大量データの分析、簡単なアプリ作成など多岐にわたる作業をチャット形式で簡単に行うことができます。

例えば「〇〇のデータを集計して、CSVで出力して」とか「会議の音声ファイルからWhisperを利用して文字起こしを作って」など自然言語で指示を出しAIとともに作業を行うことが出来ます。

詳しくは下記公式でも動画を参照ください。

Open Interpreter利用時の問題点(コスト以外で)

- 実行環境が汚れる

- 利用環境構築、整備の敷居が高い

Open Interpreterを動かしていると、ミドルウェアやライブラリがどんどんインストールされていき、しかもシステムインストールされることもあるため実行環境が汚れがちです。

またPython環境が整っていない場合、各々の環境差異も考えるとOpen Interpreterを動かすまでの敷居が高いと感じていました。

Open Interpreter利用時の注意点

- Open Interpreterは大変便利ですがOpenAI API / Azure OpenAI APIの費用が非常にかかるため、コスト監視や利用者への教育は必ず行いましょう。(重要なので何度も書きます)

- Open Interpreterのリリース直後に筆者が動かしたときは30分でAPI利用費用が$10を超えていて、気づかずに一日動かしていたらとヒヤッとしました

(参考価格) 2024年2月19日現在のOpenAI API gpt-4の価格

| Model | Input | Output |

|---|---|---|

| gpt-4 | $0.03 / 1K tokens | $0.06 / 1K tokens |

| gpt-4-32k | $0.06 / 1K tokens | $0.12 / 1K tokens |

なぜエンジニア職でない方達にもOpen Interpreterを利用してもらいたいのか

- 当社が情シスの会社なので、業務効率化の観点からプログラミングの知識がない方にもAIを使いプログラミング作業を行うことが出来る状態を作りたいと考えている

- 生成AI活用の領域をチャットからさらに広げたい

- それぞれが持っている課題に対してAI+プログラミングを活用することで、業務効率化を図りたい

Open Interpreter専用環境の候補

コンテナを利用する

筆者も利用しており、すでに多くの人が利用しているかと思いますが、Dockerを利用してコンテナ内で閉じ込め、ホスト側の環境を汚さないようにできます。

メリット

- コンテナにより統一された環境構築が容易

デメリット

- 環境構築の敷居が高い

- マシンスペックがそれなりに必要

- トラブルシューティング時の調査コストの高さ

こちらはWeb検索をしていただければ多くの有用な記事が見つかるので詳細は割愛します。

ただコンテナ利用はエンジニア職の以外の方達にとっては環境構築の敷居が高いのと、それなりにマシンスペックが必要になるため、今回のケースでは最適でないと判断しました。

GitHub Codespacesを利用する

メリット

- 統一された環境構築が容易

- スペックの拡張も容易

デメリット

- GitHubのアカウントや組織設定、課金設定などが必要

既にGitHubを利用している組織ならそこまで工数がかからず、利用が出来るかと思いますが、新規にGitHubを契約する必要がある組織の場合は初期設定がボトルネックになるかも知れません。

筆者が検証した感じだと、一番安価はVMでも十分な印象でしたが、複雑な計算処理を行う場合はスペックを上げる必要が有りかも知れません。

Codespaces価格体系 (2024年2月19日現在)

VMごとの課金

| Cores | RAM | Price |

|---|---|---|

| 2 core | 4GB | $.18/時間 |

| 4 core | 8GB | $.36/時間 |

| 8 core | 16GB | $.72/時間 |

| 16 core | 32GB | $1.44/時間 |

| 32 core | 64GB | $2.88/時間 |

Codespacesストレージ

利用していないときの料金

- $0.07/ギガバイト/月

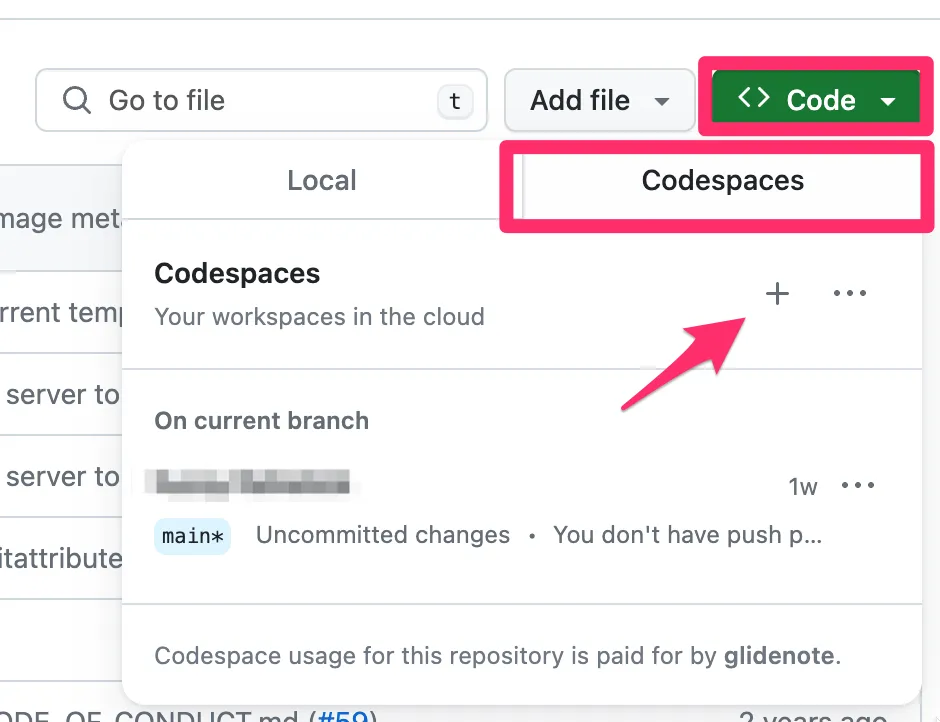

利用方法は GitHub Codespacesの公式ドキュメントに従い、https://github.com/microsoft/vscode-remote-try-python にアクセスし、 Code => Codespaces とクリックするだけで動かすことが起動可能。

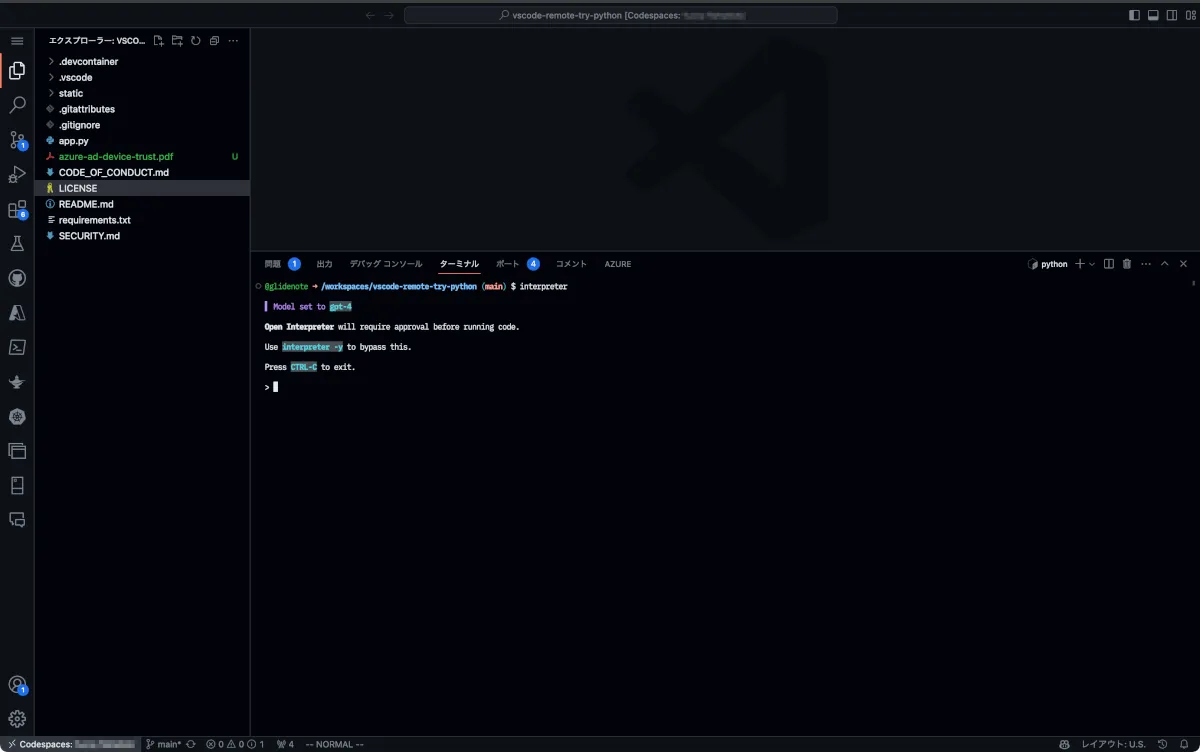

Python環境はすでに揃っている状態なので、下記でOpen Interpreterをインストールするだけで利用可能です。

pip install open-interpreter

見た目はVisual Studio Codeそのままで、ブラウザ上で操作ができるため、非エンジニア職の方にも敷居が低いと感じました。余談ですがGitHub Codespaces拡張機能を利用することでVisual Studio Codeからも利用可能です。

Dev Containerの設定がそのまま利用出来るため、postCreateCommand でOpen Interpreterをインストールも可能ですし、専用Repoを作りエンジニアはローカルでDev Containerを利用し、非エンジニア職の方はCodespacesを利用することでメンテナンスコストを抑えることができます。

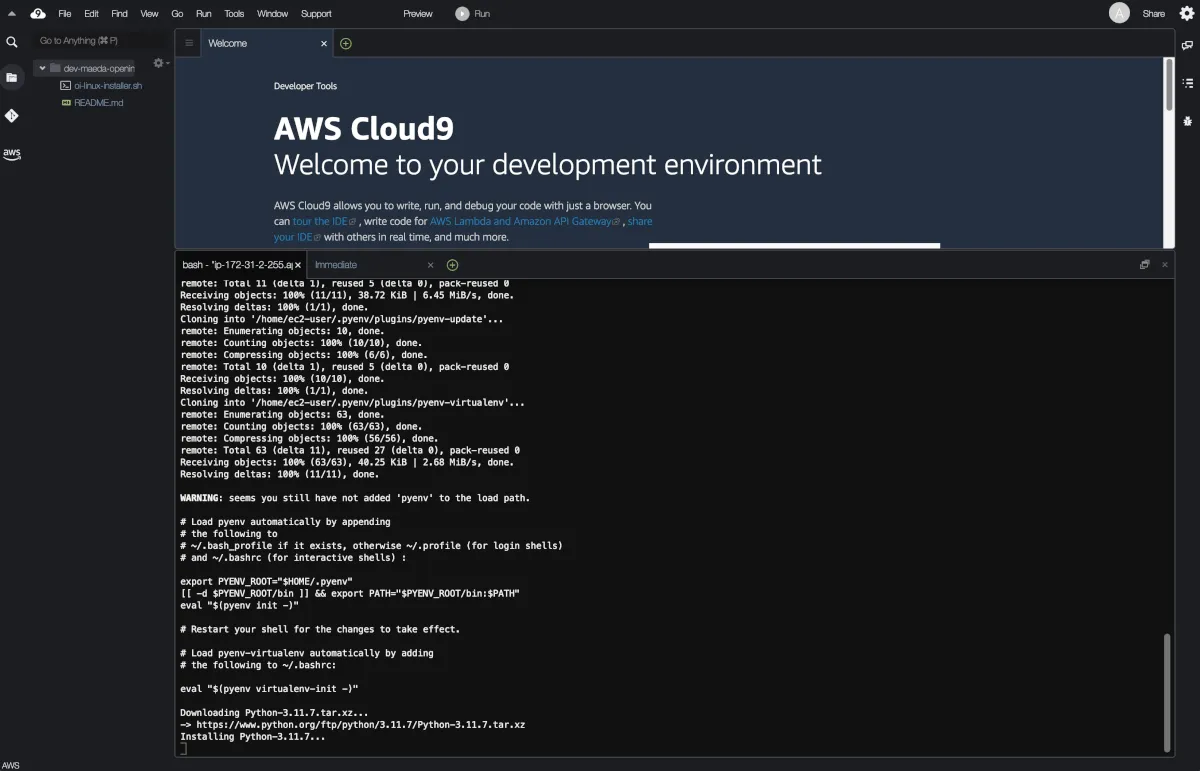

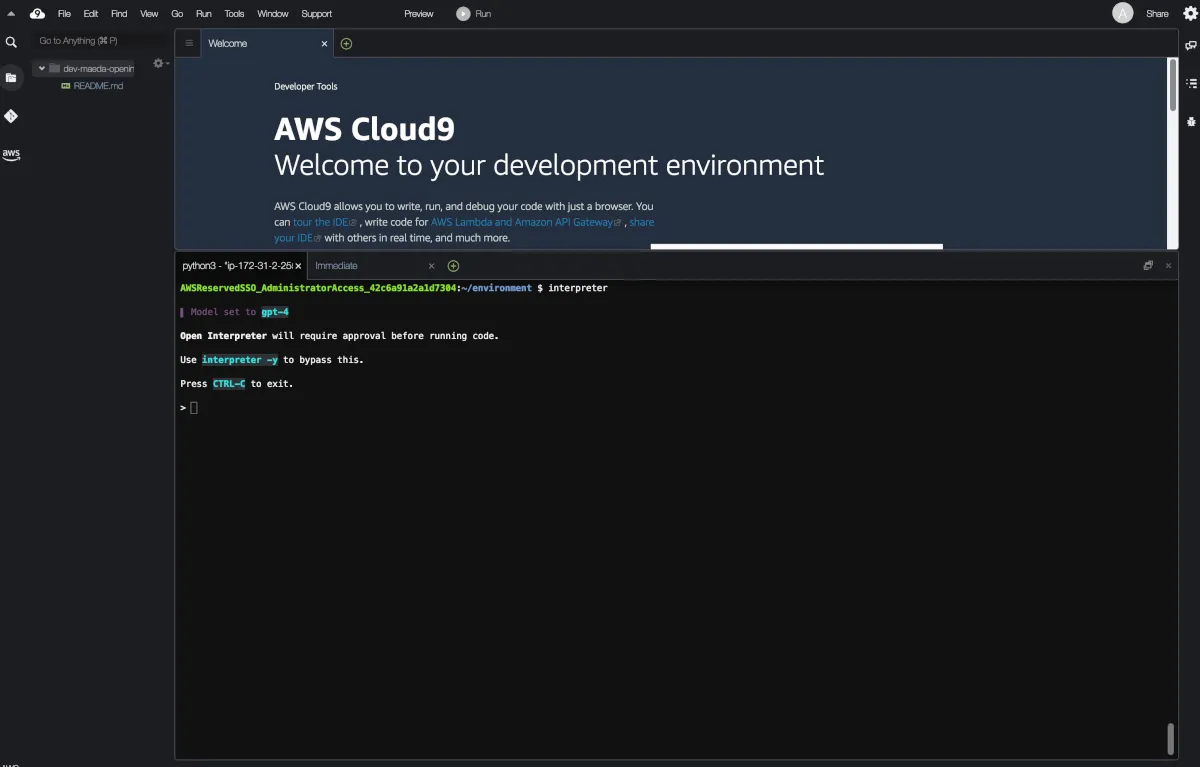

AWS Cloud9を利用する

メリット

- 自由度が高い

デメリット

- AWSアカウントの各種設定が必要

- (GitHub Codespacesに比べると)利用までの手順が多い

AWSの環境が整備されていれば、AWS Cloud9も候補になります。ただGitHub Codespacesと比較すると、今回の実現したいことに対して、作業工数が多く、使い勝手が悪いと感じました。

筆者はAWSとLinuxに慣れているので、自由度が高くAWS Cloud9は割と好きです。Open Interpreterの動作環境としてはGitHub Codespacesと差はありません。

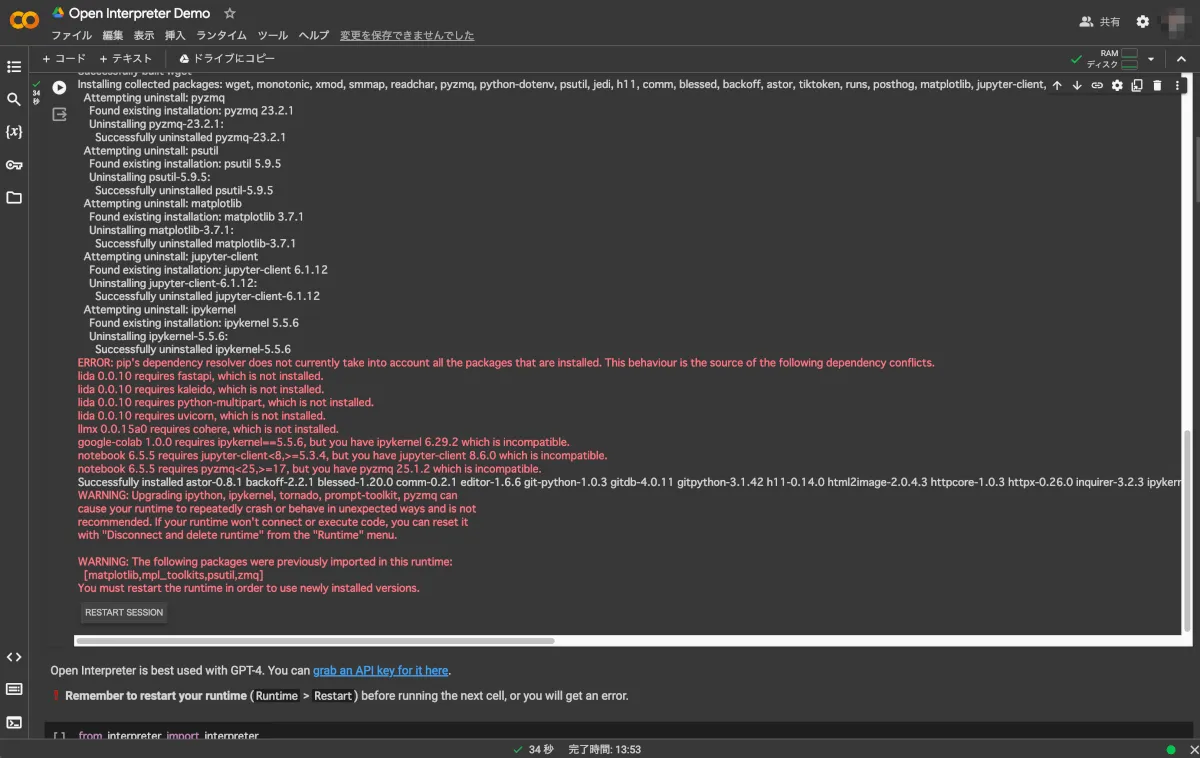

Azure Cloud Shell と Google Colab について

Azure Cloud ShellとGoogle Colabも検証しましたが、2024/02/19現在Open Interpreterが正常に動作しなかったため、候補から除外しました。

Open Interpreter公式がGoogle ColabにDemo環境を用意しているのですが、Open Interpreterのインストールに失敗し、デモが動かない状態となっています。

以前からGoogle Colab上だとOpen Interpreterの動作が不安定で、調査をしたこともあるので、個人的にはイマイチな印象です。

まとめ

- 情シス活用観点から、社内の誰もが手軽にAIプログラミングを利用できるOpen Interpreter専門環境の構築について調査

- 2024年2月19日現在Open Interpreter専用環境を用意するならGitHub Codespacesが良い

- 重要なので何度も言いますが、Open Interpreterは大変便利ですがOpenAI API / Azure OpenAI APIの費用が非常にかかるため、コスト監視や利用者への教育は必ず行いましょう